摘 要:当今的疲劳监测系统的监测方式比较单一,可靠性较低,若采取多种监测方式融合又受到汽车有限空间内布线越来越困难的限制。针对这一系列问题,本文提出了基于ZigBee的无线传感网络技术与传感器信息融合技术相结合的疲劳驾驶警示系统,系统由CC2430 和协调器负责zigbee 网络的组建和管理,高性能处理器完成疲劳信息的融合。经过测试表明,该系统适于车载运行并能够较好地对疲劳行为进行监测,可靠性可达95%。

1 引言

随着汽车业的快速发展,与之相关的交通事故也在快速增高,而这些事故中,疲劳驾驶所造成的交通事故约占总数的16%,在高速公路上更是超过了 20%[1],因此研制疲劳驾驶预防和报警装置成为当今疲劳驾驶研究的重点和难点。随着新技术的出现和发展,本文提出了基于ZigBee 无线传感网络技术与信息融合决策技术相结合的疲劳驾驶系统。通过ZigBee 技术组建的网络有如下特性:监测方式由于单一而导致系统性能欠佳[2],而系统的扩展又受到车身空间布线、成本等各方面的限制。因此利用ZigBee 技术无线、安全、可靠、低功耗等特点,将单片机控制技术与之结合,引入到车辆传感器的设计中,不仅可以省去通信电缆的安装,降低安装工程量,还可以安全可靠地实现数据传输和网络互联,从而开发出适用性更强的车辆传感器。另外ZigBee 技术低功耗、低成本的特点非常适合行车途中。

2 疲劳检测系统架构与原理

2.1 ZigBee 网络的组建与通信

基于车内各节点通信距离比较短,无需路由器扩展网络覆盖面,本模型采用 Zigbee 星形网络结构,只需要协调器和各传感器设备即可构成网络,从而降低整个系统的组网复杂程度。中间的协调器负责发起和维护网络,并将收集到得信息交给高性能处理器完成信息的融合决策,再由处理器把疲劳判断结果传给警示器。

(1)车道偏离检测、眼睛频率检测、眼睛闭合时间检测、打哈欠这4 处先由传感器收集原始图像的信息,再将信息传给各自的DSP 芯片去处理,得到疲劳信息,最后将采集信号处理的结果传输给ZiBee SoC 模块。这里采用TI 公司的CC2430,单个CC2430 芯片上整合了ZigBee 射频(RF)前端、内存和微控制器。在接收和发射模式下,电流损耗分别低于27mA 或25mA。CC2430 对于车载系统要求非常长电池寿命的要求来说是比较适合的。这4 处的信息最后都由CC2430 发送给协调器。具体的实现框架流程图见图1。

(2)Coordinator 负责组网和管理各终端传感器,组网基本流程为:首先进行能量扫描和激活扫描信道,如果发现合适的信道,则创建一个唯一的16 位网络PAN ID,在ZigBee网络系统中Coordinator 的网络短地址固定设置为0,然后开始向四周广播网络信息,并接受处理其网络覆盖范围内的加入网络的请求,然后加入新节点的信息。组网流程图如下,见图2。

从流程图我们可以看到协调器并不处理和保存传感器节点发来的信息,它直接将疲劳信息交给高性能处理器处理,这样协调器能更好地管理网络。处理器负责实现多个疲劳特征的融合判断。该模型将协调器与信号汇聚节点(网关)统一设计,协调器/网关负责与各个终端设备的通信与外网的通信。如果驾驶员疲劳驾驶情况严重,易于造成交通事故的时候,协调器将驾驶员信息送入网关,然后转化成外部网络的信息格式,最后通过GSM/GPRS 方式与公路安全网通信,发往远程监控设备。

[page]

2.2 传感信息获取技术

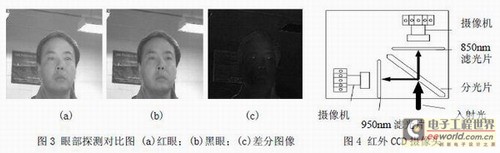

驾驶员面部图像通过红外摄像机和 LED 来获取,其中用于照明的LED 能够发出光谱分别为850nm 和950nm 的光线。当使用不同红外光谱的时候,眼睛瞳孔会呈现出不同颜色。当用 850nm 红外光照明,瞳孔呈现出红色,即俗称的红眼效应;而用 950nm 红外光照明,瞳孔却呈现出黑色。两幅图像除了瞳孔以外,脸部其它部位都是一样的。通过比较这两幅图像,就可以很容易定位到眼部,再通过一系列图像处理来得到面部的参数和实现眼部跟踪。另外,使用红外LED 在减少周围光线干扰确保图像质量的同时,还能减少对驾驶员视觉的干扰,因为它的光线几乎是看不到的。眼部对比情况如图3:

为了能够同时得到图3 的(a)、(b)两幅图像,可以采用图4 所示的红外摄像头装置,当入射光照到中间的分光片(它可以将入射激光线分离为反射/ 透射比为 1 的两束光线)的时候,能将入射光线平行分成两束,再分别经过850nm 和950nm 的滤光片进入到摄像头中,这样在同一时刻得到的两幅图像除了瞳孔颜色不同,其它的都是一样的。为了在有限的时间内完成大量图像数据的处理,

车道偏移检测即基于车辆的行为来间接地反应司机的疲劳迹象。我们将 CCD 摄像头朝向汽车行驶方向,监测车辆的行驶方向,同时监测转向灯。如果汽车方向改变而转向灯没有开启,则认为驾驶员有进入疲劳驾驶的可能。车辆行为的检测不是基于人为表现活动,这样能互补面部检测的不足和人为差异,同时在驾驶员不是由于疲劳而是因为其他因素(如手机、音乐、小孩)造成注意力不集中判断错误的时候,也能给予一定得提醒。

2.3

我们以 120ms 为一个小周期,因为本系统能在40ms 内采集到一帧的图像,则后80ms用于图像处理,这样在一分钟内共有500 帧的图像。通过这些图像来分析驾驶员的疲劳情况。根据人体工程学原理,人体出现疲劳的时候,眨眼频率在某个时段比正常时明显加快,这是驾驶员在疲劳时试图保持清醒的反应,进入更深层次疲劳时就会出现眼睛闭合一次时间加长的特征。清醒时眼睛一睁一闭的过程只需要几帧倒十几帧的时间(0.25 秒以内),而疲劳时则需要20 帧或一两秒;打哈欠的时候嘴部垂直半径明显加大。我们先采集驾驶员正常时候的眨眼频率,眼睛闭合一次时间和嘴部信息,然后再与发生疲劳时候的情况进行对比,以此判断疲劳程度。我们采用模糊逻辑法来对采集到得信息进行融合决策。例如:当Coordinator只接收到眨眼频率、眨眼时间有疲劳异常的时候,将进行如下方式的融合:

(1)输入及输出变量隶属度函数的建立:对于两个输入变量眼睛闭合一次的时间和眨眼频率以及一个输出变量(驾驶员的疲劳状态),分别定义三种不同程度的模糊集合,对每一个变量,选择适当的隶属度函数。其说明如下:眨眼频率={快、中、慢};眨眼时间={短、中、长};疲劳状态={不疲劳、轻微疲劳、疲劳}。在本文中选用归纳推理法来确定隶属度数,采用三角形隶属度函数。

(2)模糊化与模糊推理规则的建立:模糊化是把精确的测量值经归一化转换到输入变量对应的论域中,再经由所定义的隶属度函数,将其转化为合适的模糊化语言变量,也就是隶属度以供模糊推理使用。在本文中,输入变量为眨眼时间和眨眼频率,我们采集的图像经过处理后得到眼睛睁闭的情况,并将眨眼频率转换为眨眼频率快、眨眼频率中、眨眼频率慢、眨眼时间长、眨眼时间中、眨眼短等模糊语言。因为我们对于眨眼频率以及眨眼时间各选用三种程度的模糊集合。因此,其相互间最多可得32=9 条控制规则,推理如下表1:

(3)模糊清晰化:模糊清晰化是将模糊逻辑推理后的模糊变量换算成实际的操作量表现出来。文中选用质心法,其计算公式如下。R:模糊控制器输出量;k:规则数;xi:第i个规则的隶属度;Fi:第i 个规则隶属度函数的质心值。疲劳状态数值越高表示越疲劳,本文中眼睛闭合一次时间的重要性要高于眨眼频率,因为眨眼持续时间越长代表了眼睛在眨眼过程中眼睛闭合的时间越长,不论驾驶员疲劳与否,眼睛闭合越久代表危险性越高。

实验结果对比:我们对采集的50 段驾驶员处于疲劳状态的视频分别单独使用眨眼时间、眨眼频率和二特征融合后的隶属度值进行判决,实验结果显示融合后正确率明显提高。同理,当出现打哈欠、车道路线偏移等疲劳特征时,我们用同样的方法进行融合,系统的正确率达到95%。

3 结论

全文对基于

上一篇:恩智浦与合作伙伴启动欧洲eCall试验,加快应急响应时间

下一篇:汽车ADAS面临的挑战及解决方案

推荐阅读最新更新时间:2024-12-18 19:01

汽车电气与智能系统

汽车电气与智能系统 Verilog HDL数字集成电路设计原理与应用

Verilog HDL数字集成电路设计原理与应用 AP358N

AP358N

京公网安备 11010802033920号

京公网安备 11010802033920号